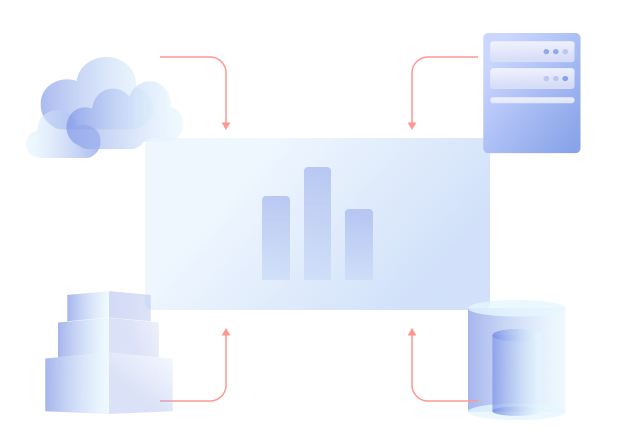

Treffen Sie besser informierte und schnellere Entscheidungen

Der Zugang zu harten Daten aus verschiedenen Bereichen einer Organisation kann die Führung befähigen, fundiertere Entscheidungen zu treffen und schneller dorthin zu gelangen.

Speak to a rep about your business needs

See our product support options

Allgemeine Anfragen und Standorte

KontaktDie Datenintegration sammelt Informationen aus verschiedenen Quellen und verändert sie in ein einziges Format. Für Unternehmen mit vielfältigen Datendepots über verschiedene Bereiche und Funktionen hinweg muss darauf geachtet werden, das Projekt richtig zu identifizieren und zu dimensionieren. Ein Datenintegrationsprozess umfasst im Allgemeinen die folgenden Schritte:

Die Organisation muss alle Datenquellen identifizieren, die in die einheitliche Lösung integriert werden müssen. Dies kann Datenbanken (vor Ort und cloudbasiert), APIs, Altsysteme und Tabellenkalkulationen umfassen.

Mit geeigneten Werkzeugen oder Prozessen werden Daten aus den identifizierten Quellen extrahiert. Dies kann das Abrufen von Dateien aus entfernten Orten, Datenbankabfragen oder API-gesteuerte Datenabrufe umfassen.

Obwohl verschiedene Datenquellen ähnliche Informationen enthalten können, verwenden sie unterschiedliche Terminologien oder Codestrukturen zur Darstellung. Um während des Integrationsprozesses die gewünschte Datenausrichtung zu erreichen, erstellen und implementieren Entwickler ein Mapping-Schema, um zu definieren, wie Datenelemente verschiedener Systeme miteinander übereinstimmen.

Es wird eine Datenvalidierung durchgeführt, bei der die Daten überprüft werden, um Fehler oder Probleme mit der Datenintegrität zu identifizieren und Genauigkeit und Qualität nachzuweisen. QA-Prozesse werden implementiert, um Zuverlässigkeit und Genauigkeit der einheitlichen Daten zu gewährleisten.

Die extrahierten Daten werden für Kompatibilität und Konsistenz in ein gemeinsames Format zusammengeführt. Dies kann zusätzliche Ebenen der Datenbereinigung, Anreicherung und Normalisierung umfassen.

In dieser Phase werden die transformierten Daten an ihren gewünschten Ort, beispielsweise ein Data Warehouse, geladen, um weitere Analysen und Berichte durchzuführen. Je nach Anforderungen kann der Datenladeprozess entweder durch Batch- oder Echtzeit-Laden durchgeführt werden.

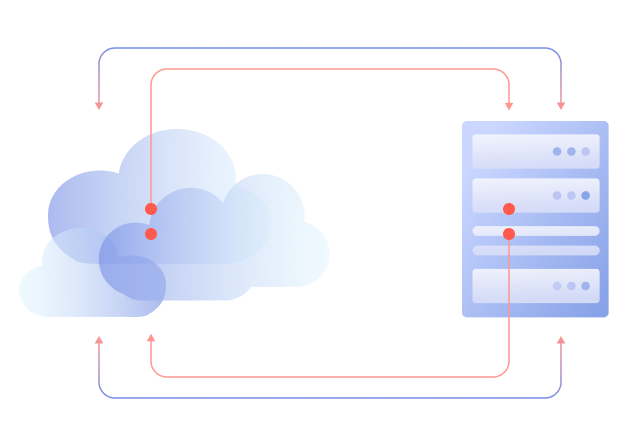

Datensynchronisation hält integrierte, verarbeitete Daten aktuell und aktuell. Dies kann durch periodische Aktualisierungen erfolgen, etwa über Nacht oder außerhalb der Hauptverkehrszeiten, oder durch Echtzeitsynchronisation, wenn sofortige Integration neuer Daten erforderlich ist.

Branchen wie Gesundheitswesen und Finanzen stehen unter zusätzlicher rechtlicher Prüfung in Bezug auf Datenschutz und Sicherheit. Daten-Governance-Praktiken stellen sicher, dass sensible Daten integriert und gemäß regulatorischen und Datenschutzanforderungen verarbeitet werden.

Nutzer integrierter Daten benötigen möglicherweise zusätzliche Möglichkeiten, die Herkunft, Bedeutung und den Kontext der Daten leichter zu verstehen. Dies wird durch den Zugang zu Metadaten erheblich verbessert, die Informationen über die integrierten Daten liefern und deren Auffindbarkeit und Benutzerfreundlichkeit verbessern.

Die integrierten Datensätze können über verschiedene Werkzeuge abgerufen und analysiert werden, darunter Berichtslösungen, BI-Software und spezialisierte Analyseplattformen. Analysten und Entscheidungsträger werden befähigt, Erkenntnisse für bessere Geschäftsstrategien und schnellere Entscheidungsfindung zu gewinnen. Durch die Integration von Daten aus verschiedenen Quellen, deren Bereinigung, das Umsetzen in ein gemeinsames Format und die Aktualisierung der Daten können Unternehmen ein einzigartiges Werkzeug in ihrem Arsenal haben, um schneller bessere Entscheidungen zu treffen und ihre DataOps-Initiativen zu unterstützen.

Es gibt verschiedene Arten der Datenintegration, jede mit ihren eigenen Vor- und Nachteilen.

The classic data processing approach, ETL is a bulk or batch data movement approach that extracts data from its source to some sort of midpoint staging area, where it is transformed or processed into the desired format, and then loaded into a data warehouse for analysis.

This tried-and-true method remains in use for many data processing systems, particularly in scenarios where data quality and consistency are a leading requirement. However, this approach doesn’t lend itself well to real-time data processing needs where speed and scalability are paramount.

Diese Methode ist eine Weiterentwicklung von ETL, die die Verarbeitungskapazitäten moderner Datenspeichersysteme nutzt. Nachdem die Daten extrahiert wurden, werden sie direkt in ein Data Warehouse geladen, wo sie dann in das gemeinsame Systemformat umgewandelt werden. Aufgrund seiner Geschwindigkeit und Flexibilität ist ELT eine bevorzugte Methode in Szenarien, in denen Echtzeitverarbeitung und Skalierbarkeit erforderlich sind.

Streaming-Datenmethoden erfassen und verarbeiten Daten in Echtzeit, sobald sie aus Quellsystemen generiert werden, und integrieren sie direkt in ein Data Warehouse oder einen Data Lake für die sofortige Nutzung. Moderne Technologien haben verschiedene Echtzeit-Datenintegrationsmethoden eingeführt, wie Change Data Capture (CDC), Application Integration (API), Data Virtualization und Federated Data Integration, die jeweils einzigartige Vorteile für Organisationen bieten, die aktuelle Erkenntnisse suchen.

Change Data Capture (CDC) verfolgt und repliziert Änderungen – wie Einfügungen, Aktualisierungen und Löschungen – in der Quelldatenbank auf ein Zielrepository, wodurch Echtzeit-Datensynchronisation und Integration mit ETL oder anderen Tools möglich ist. Ein logbasiertes CDC wird in Umgebungen mit hohem Volumen im Allgemeinen bevorzugt, da es Änderungen direkt aus Transaktionsprotokollen erfasst und so die Leistungsbeeinträchtigung der Datenbank minimiert. Triggerbasierte CDC ist zwar effektiv für die Echtzeit-Datenerfassung, kann aber aufgrund des Overheads der Trigger eine höhere Belastung für die Datenbank verursachen.

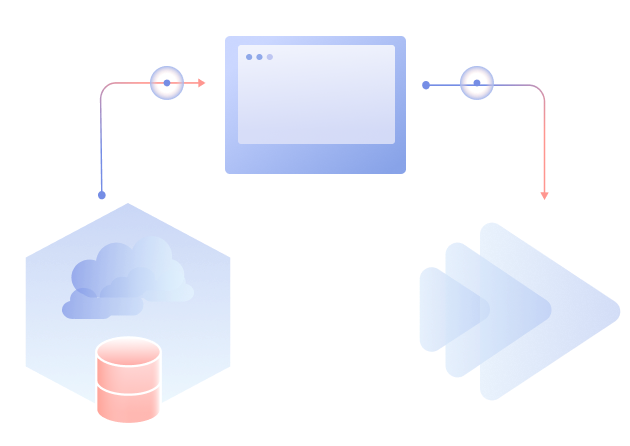

Die Anwendungsintegration mit APIs ermöglicht es verschiedenen Softwareanwendungen, in Echtzeit zu kommunizieren und Daten auszutauschen, was nahtlose Interaktionen und Datenfluss zwischen unterschiedlichen Systemen ermöglicht. APIs ermöglichen Automatisierung und Echtzeit-Datenaustausch über Plattformen hinweg und spielen in verschiedenen Szenarien eine entscheidende Rolle, wie etwa die Verbindung von E-Commerce-Seiten mit Zahlungsgateways oder die Interaktion mobiler Apps mit sozialen Medienplattformen.

Datenvirtualisierung schafft eine virtuelle Schicht, die den Nutzern eine einheitliche Ansicht von Daten aus mehreren Quellen in Echtzeit bietet, ohne dass die Daten physisch verschoben werden. Diese Methode ermöglicht es Organisationen, Daten aus verschiedenen Quellen wie Data Warehouses, Seen und Cloud-Diensten zu verwalten, als ob sie in einem einzigen, zentralen Repository wären. Im Gegensatz zur Datenföderation erfordert die Datenvirtualisierung kein einheitliches Datenmodell und kann Aktualisierungen der Quellsysteme direkt durchführen, wodurch die Datenqualität erhalten und Fehler minimiert werden.

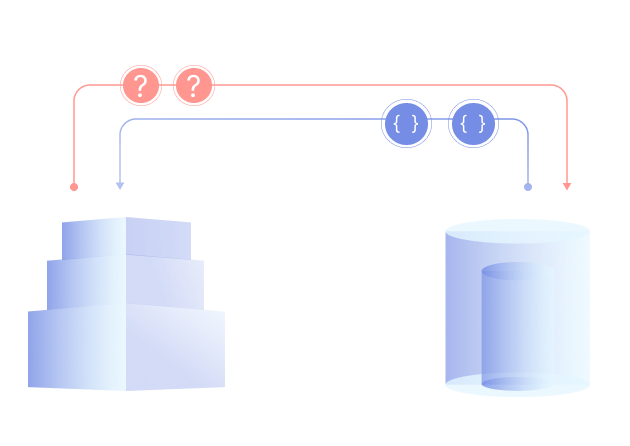

Federated Data Integration ermöglicht es, dass Daten in ihren ursprünglichen Quellsystemen bleiben und in Echtzeit über On-Demand-Abfragen abgerufen werden. Dieser Ansatz ist besonders nützlich für Organisationen mit komplexen Datenökosystemen, da er einen nahtlosen Datenzugriff ermöglicht, ohne umfangreiche Datenbewegungen oder -transformationen. Es minimiert Datenduplikation und ist ideal für Szenarien, in denen Datenkonsistenz und Echtzeitzugriff wichtiger sind als Leistung.

Datenintegration ist die Praxis, Daten aus unterschiedlichen Bereichen innerhalb einer Organisation zu vereinheitlichen oder zu einer einzigen Ansicht zu kombinieren.

Ob Vertrieb, Fertigung, Marketing oder Lieferkette – moderne Unternehmen haben Zugang zu mehr Daten als je zuvor. Aber wenn diese Daten in verschiedenen Systemen gespeichert, in inkompatiblen Formaten gespeichert und von verschiedenen Geschäftsteilen besessen werden, kann es wie eine unüberwindbare Herausforderung erscheinen, sie zusammenzuführen, damit die Unternehmensleitung sie verstehen kann.

Datenintegration hilft, diese Herausforderung zu überwinden, indem die richtigen Praktiken und Technologien verwendet werden, um alle Arten von Daten zu kombinieren und zu nutzen. Durch das Zusammenführen von Daten aus verschiedenen Quellen kann ein vollständiger, aktueller und genauer Datensatz entstehen, der der Organisation hilft, datenbasierte Entscheidungen schneller zu treffen.

Die erfolgreiche Umsetzung eines Datenintegrationsplans steht vor mehreren großen Herausforderungen, von denen viele weit über die Budgetbeschränkungen hinausgehen. Da die Datenintegration sich überschneidet zwischen Menschen und Technologien, muss eine Organisation bei einer großen Datenintegrationsinitiative viel bedenken.